На конференции I/O 2021 в мае Google представила Project Starline — систему для видеоконференций, которая может захватывать и отображать реалистичное 3D-видео. Сегодня компания поделилась более подробными техническими деталями проекта и тем, как он превосходит 2D-звонки.

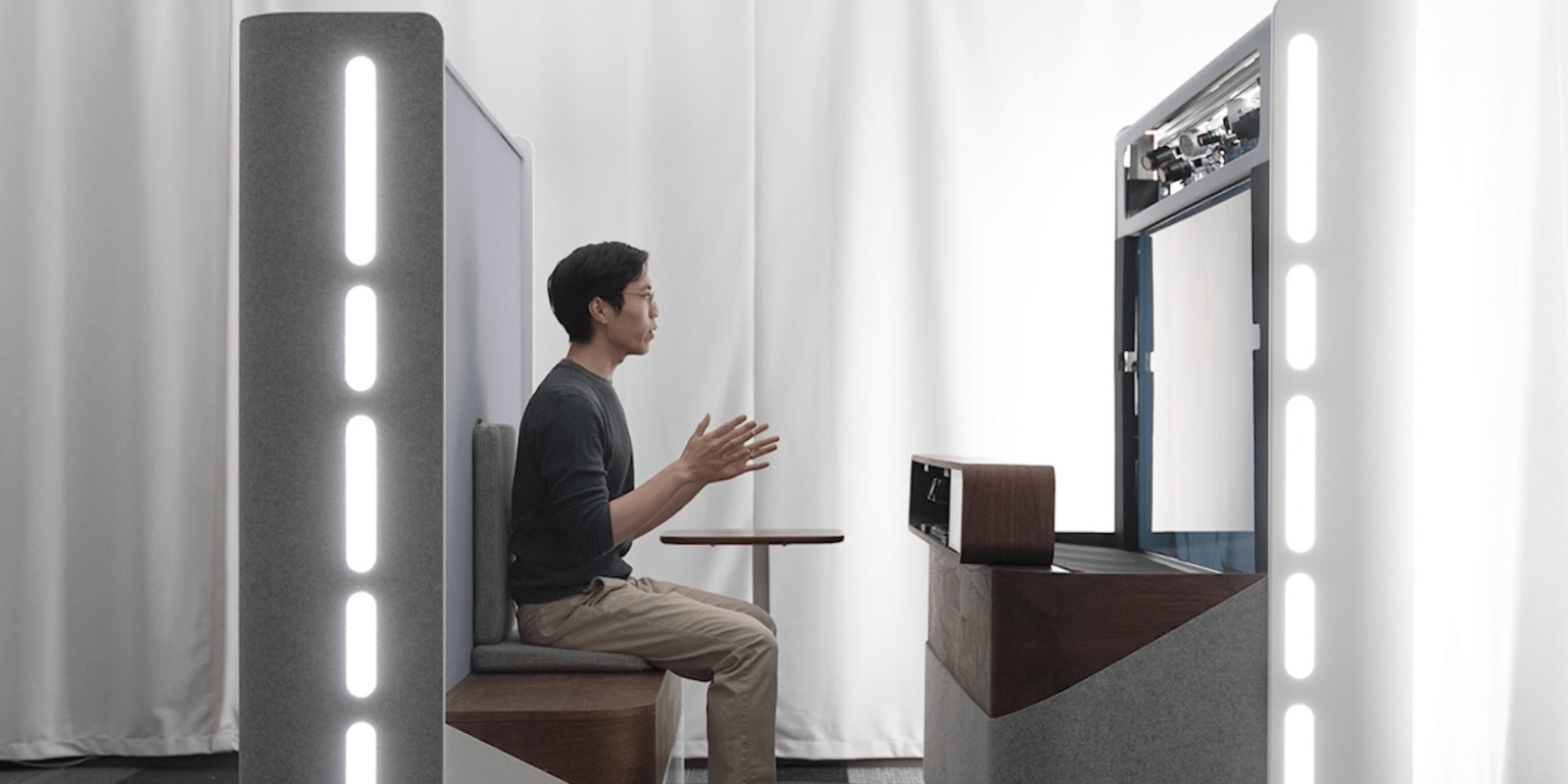

Project Starline объединяет наработки Google в области 3D-изображений, сжатия в реальном времени, пространственного аудио и своей «прорывной системы световых полей». Цель состоит в том, чтобы виртуально воспроизвести личное общение, «обеспечив ощущение глубины и реализма». Эти новые детали были представлены в техническом документе и выступлении на SIGGRAPH Asia.

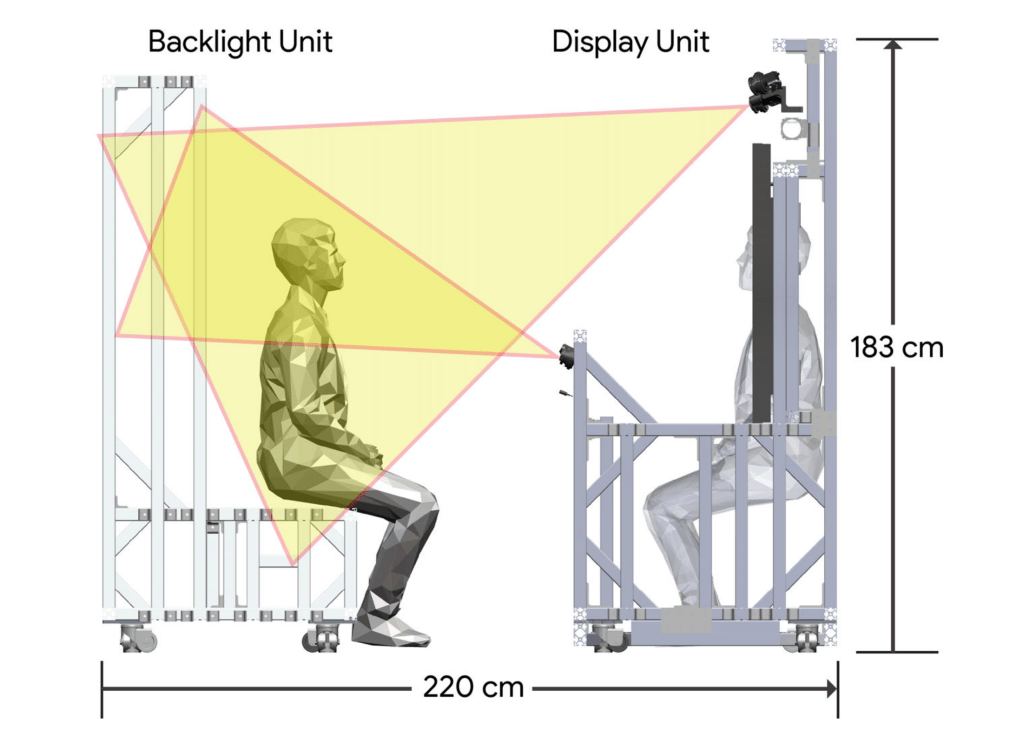

Система начинается с 65-дюймовой 8K панели, работающей на частоте 60 Гц. Google заявляет, что эта «система на основе экрана частично обусловлена значительным весом и дискомфортом, связанными с большинством современных гарнитур AR и VR», которые имеют низкое угловое разрешение и поле зрения.

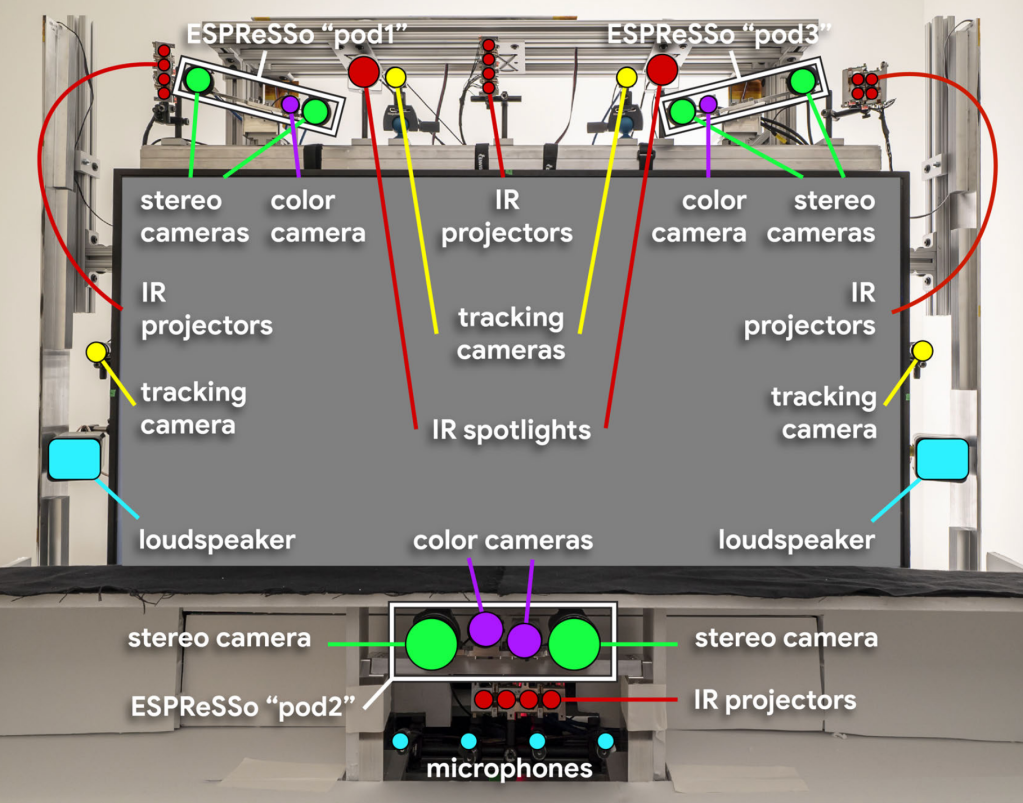

К настоящему моменту сотрудники Google, в том числе те, кто не входит в команду Starline, использовали систему «тысячи часов» для «онбординга, собеседований и встреч с новыми коллегами, презентации идей коллегам и индивидуального сотрудничества». Этот «дисплейный блок» также включает динамики, микрофоны, подсветку и компьютер, а также несколько комплектов камер:

- Четыре камеры для отслеживания лица с высокой частотой кадров (120 FPS) для «оценки 3D-положения глаз, ушей и рта с точностью до пяти миллиметров».

- Три группы камер для 3D-видео. Каждая содержит две инфракрасные и одну цветную камеру, а нижний блок содержит еще одну цветную камеру с увеличением на лицо.

В общей сложности четыре цветовых и три глубинных потока сжимаются на четырех графических процессорах NVIDIA (двух Quadro RTX 6000 и двух Titan RTX) и передаются через WebRTC.

На стороне приема, после декомпрессии, система перепроецирует три глубинных изображения в позиции глаз удаленного пользователя.

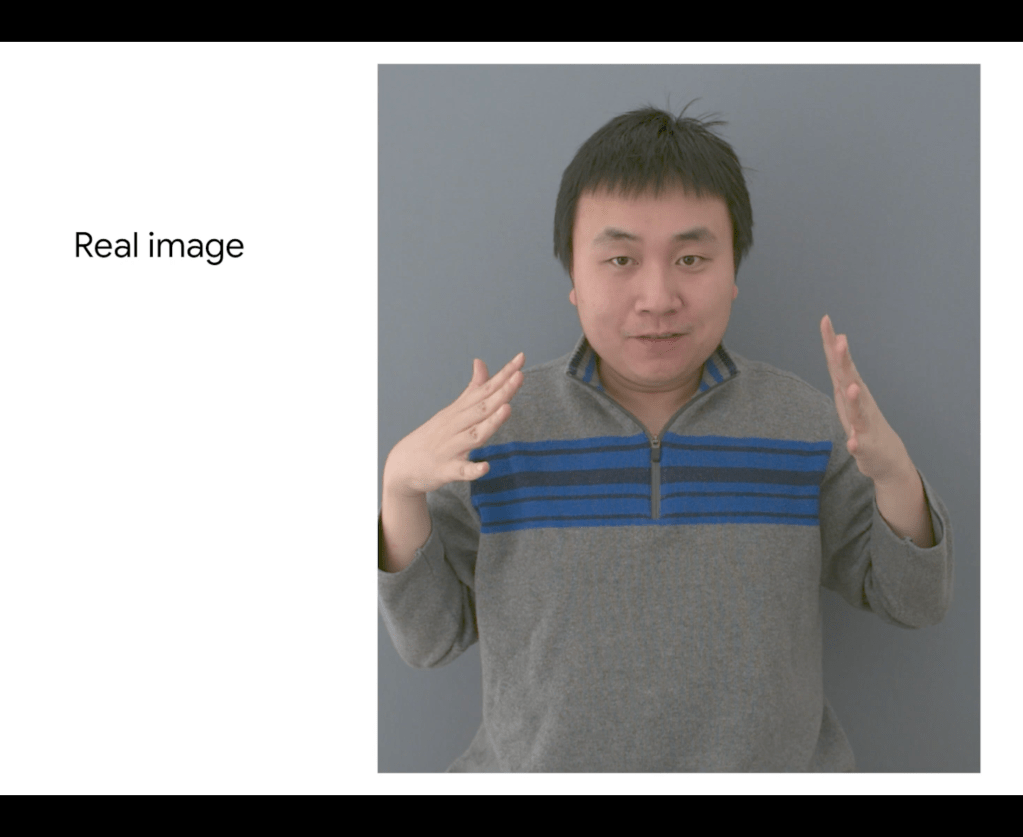

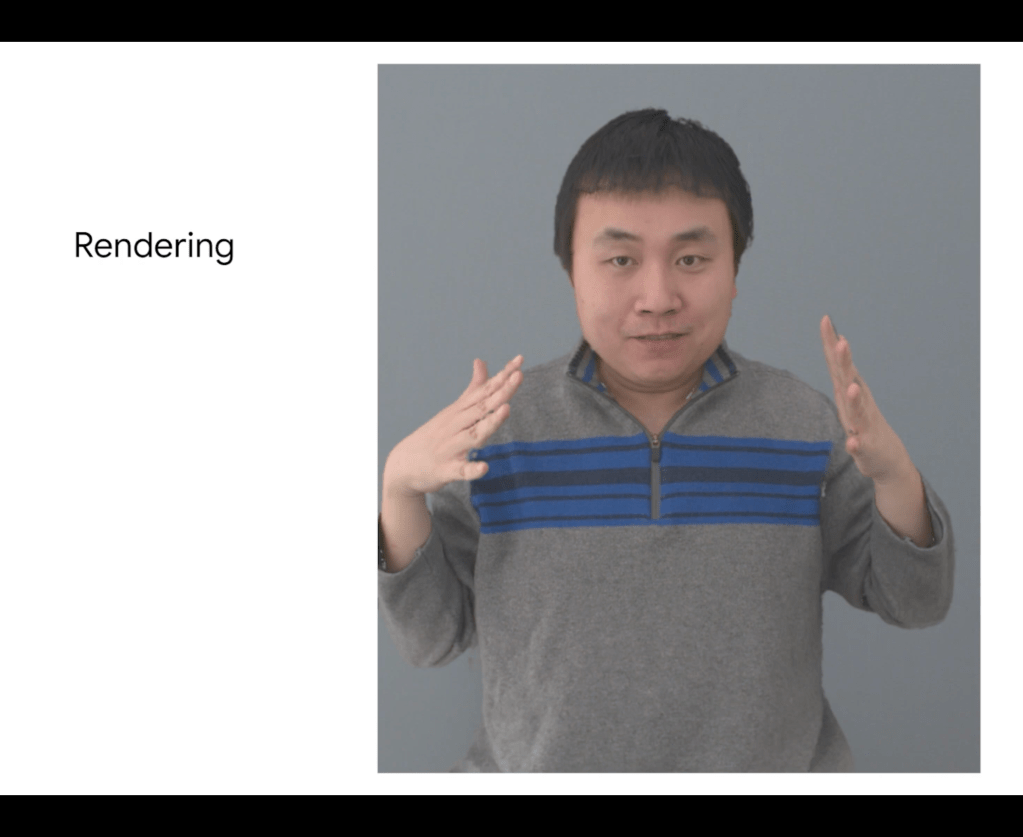

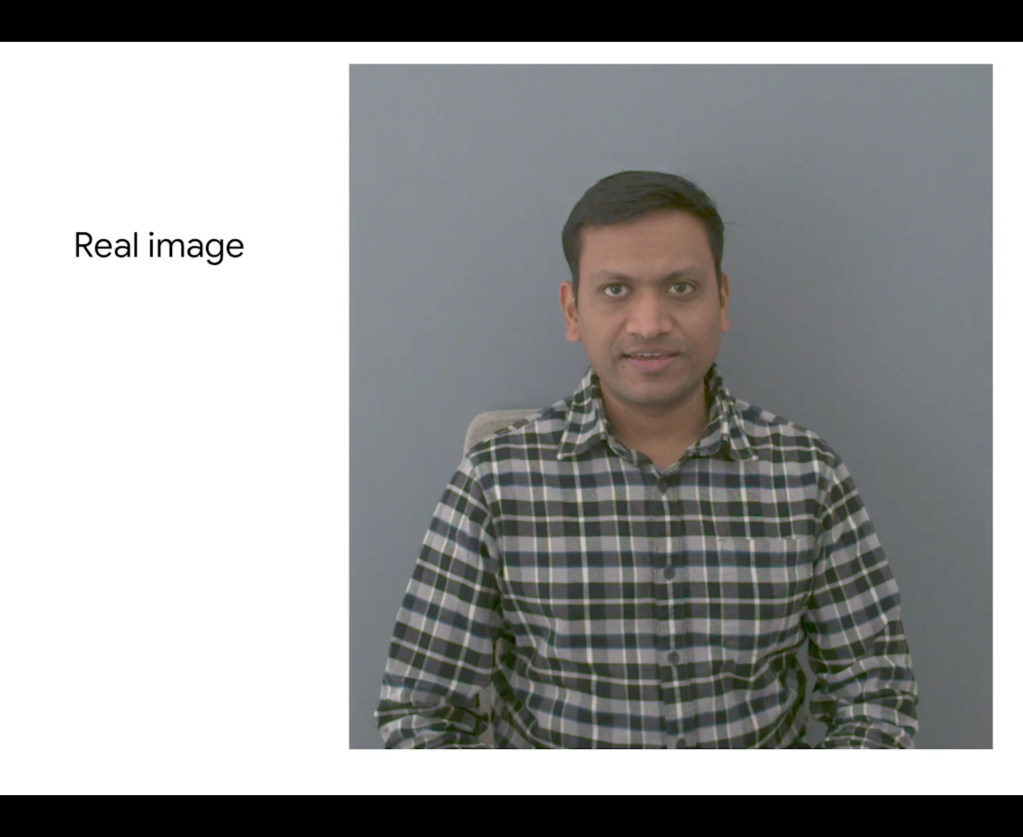

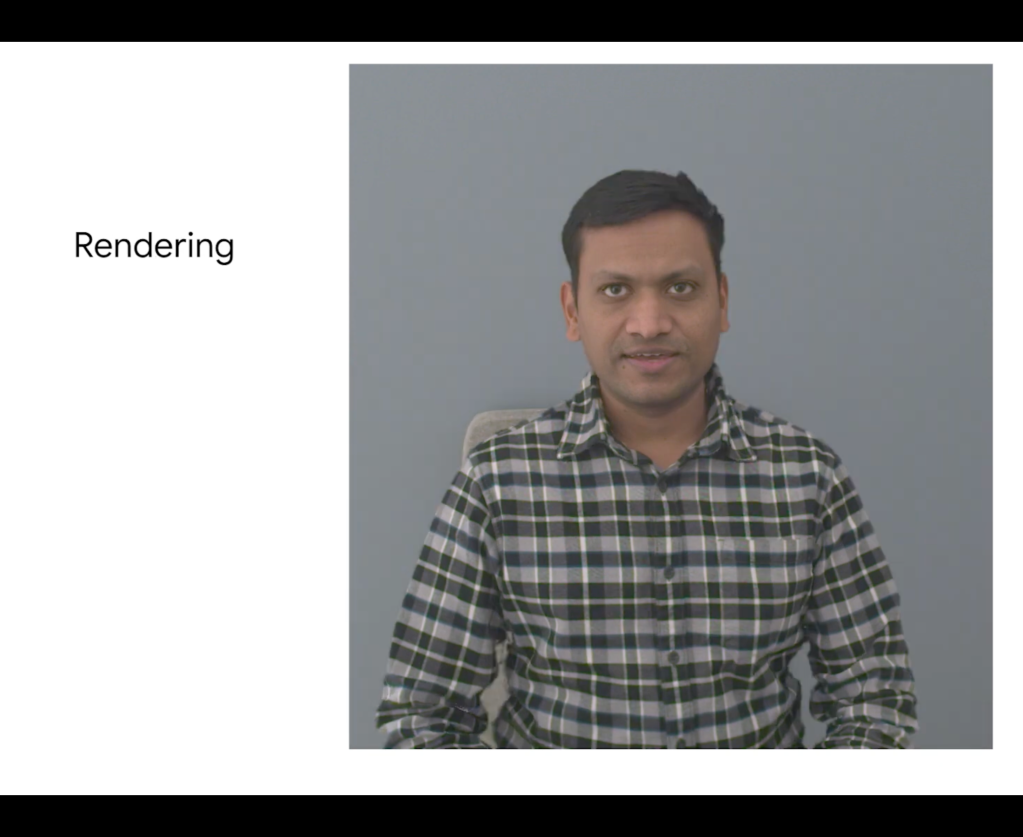

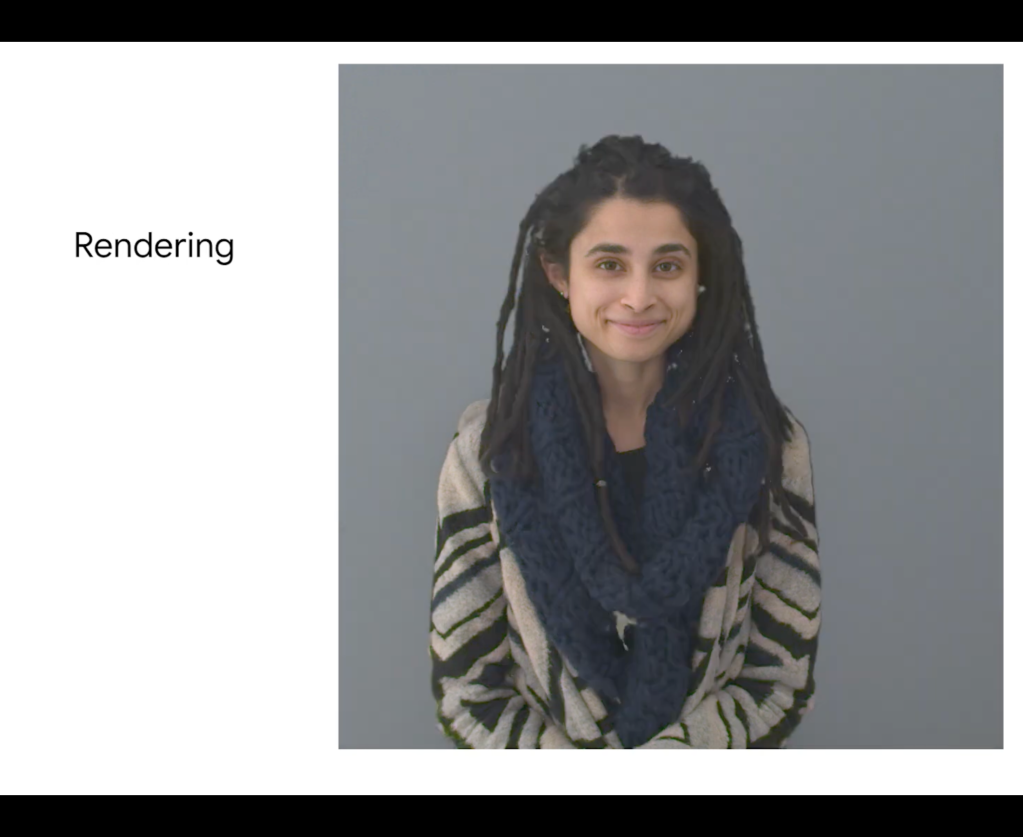

Мы можем оценить качество этой реконструкции изображения, разместив камеры перед дисплеем на линии взгляда удаленного пользователя, а затем выполнив рендеринг реконструкции с тех же точек зрения.

Тем временем «блок подсветки» служит подставкой и инфракрасным источником света, оба компонента помогают с освещением.

Что касается точности, Google обнаружила, что люди демонстрировали невербальное поведение, обычно связанное с личным общением, при использовании Project Starline:

- Примерно на 40% больше движений руками

- Примерно на 25% больше кивков головой

- Примерно на 50% больше движений бровями

Запоминаемость информации также улучшилась примерно на 30%, в то время как «люди примерно на 15% больше сосредотачивались на партнере по встрече в эксперименте по отслеживанию взгляда».