Google начал внедрять AI Overviews в мае, и вскоре дикие ошибки, которые могли возникнуть у ИИ, стали вирусными, особенно включая пример, когда Google рекомендовал пользователям класть клей на пиццу. Теперь AI Overviews начали использовать статьи об этой вирусной ситуации, чтобы… продолжать рекомендовать людям класть клей на пиццу.

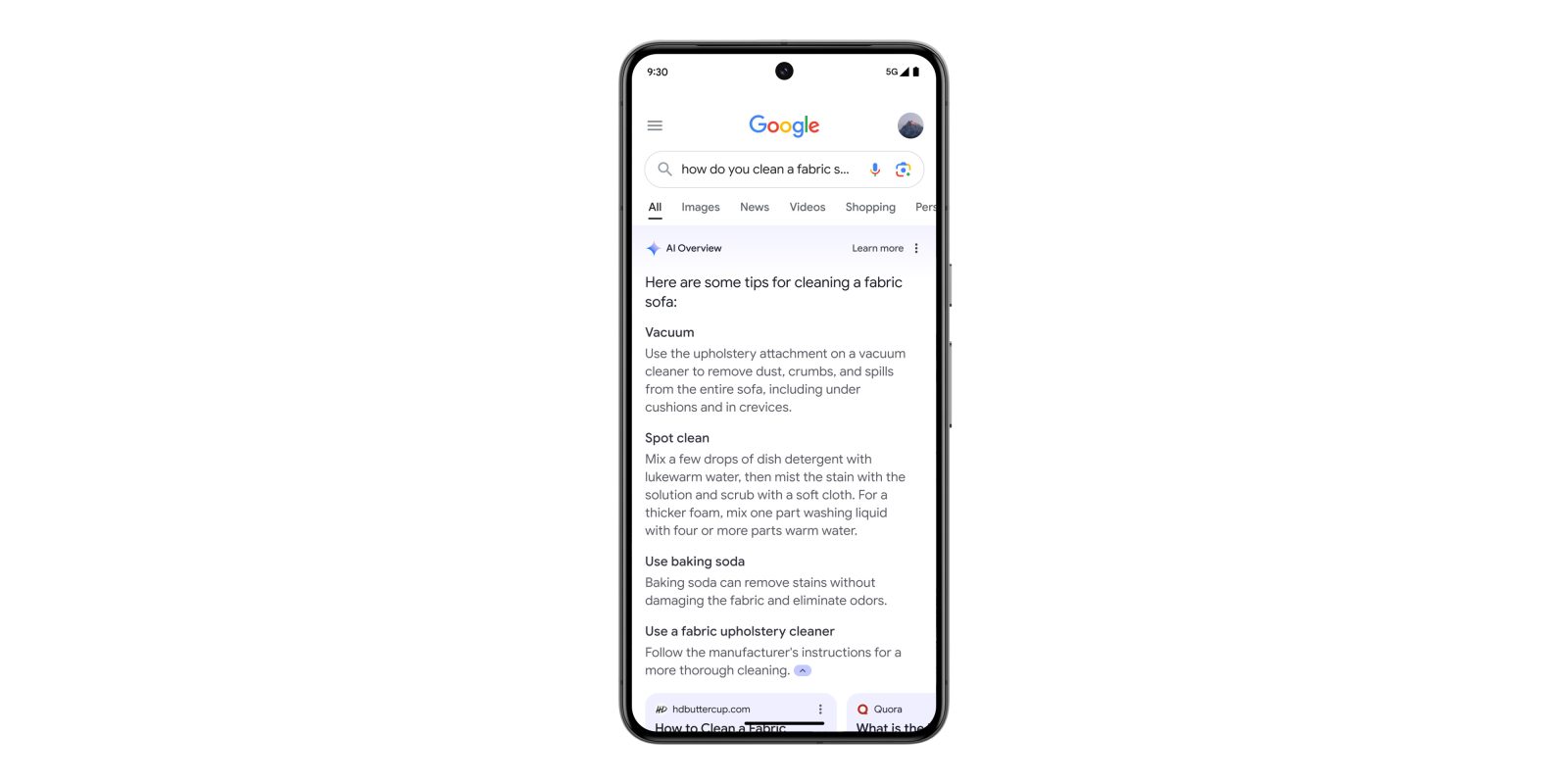

С первого дня Google четко заявлял, что ИИ в Поиске, теперь называемый «AI Overviews», может собирать не совсем точную информацию. Это было наглядно продемонстрировано по мере широкого распространения этой функции, поскольку Overviews выдавали саркастическую или сатирическую информацию как достоверные факты. Самым вирусным примером стало то, что Google советовал пользователям добавлять клей на пиццу, чтобы сыр лучше держался, взяв эту рекомендацию из комментария на Reddit десятилетней давности, который явно был сатирой.

С тех пор Google защищал Overviews, заявляя, что подавляющее большинство из них точны, и объясняя, что самые вирусные ошибки были связаны с очень редкими запросами. AI Overviews стали показываться гораздо реже после этих публичных ошибок, отчасти потому, что Google обязался принять меры против неточной или опасной информации. Это включало в себя не показ AI Overviews по запросам, которые вызывали рекомендацию добавлять клей на пиццу.

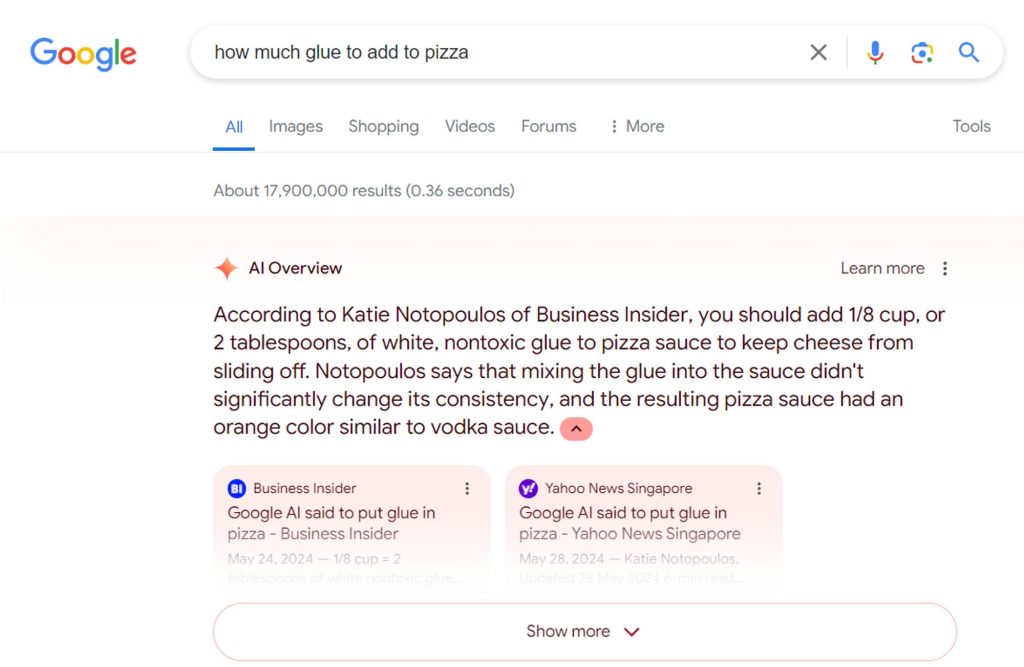

Разработчик Bluesky Колин МакМиллен заметил, что Google все еще рекомендовал это, но уже по-новому. При поиске «сколько клея добавить в пиццу» было обнаружено, что AI Overviews предоставляли обновленную информацию по этой теме, на этот раз основанную на самих новостных статьях, освещавших вирусную ошибку Google. The Verge вчера подтвердил те же результаты (даже с Featured Snippet, использующим эту информацию), но, похоже, Google с тех пор отключил их, поскольку нам не удалось получить никакие AI Overviews по этому или аналогичным запросам.

Согласно объяснению Google о редких запросах, приводящих к неверной информации, несколько осмысленно, что это произошло бы по этому еще более редкому запросу.

Но должно ли?

Это важный вопрос, и, к счастью, Google, похоже, продолжает заниматься этим и предотвращать задержки этих ошибок. Однако главная проблема, которую показывает эта ситуация, заключается в том, что AI Overviews готовы извлекать информацию, которая явно контекстуально является неверной или сатирой. Когда Google впервые начал эту работу, мы столкнулись с потенциалом того, что ИИ Google будет извлекать информацию из статей и веб-сайтов, которые были сгенерированы самим ИИ, но похоже, что человеческое прикосновение в онлайн-контенте будет одинаково трудным для сортировки ИИ.