Генеративный ИИ в контексте чат-бота может быть полезен, но иногда ведет себя неожиданно. В последнее время некоторые пользователи заметили, что Google Gemini выдает повторяющийся текст, странные символы и откровенную чушь в некоторых ответах.

Чат-бот Gemini от Google — это удобный инструмент для получения быстрых ответов или выполнения сложных задач. Но, как и любой генеративный ИИ, он также склонен к галлюцинациям. Однако в последнее время странный сбой выходит за рамки обычной ошибки.

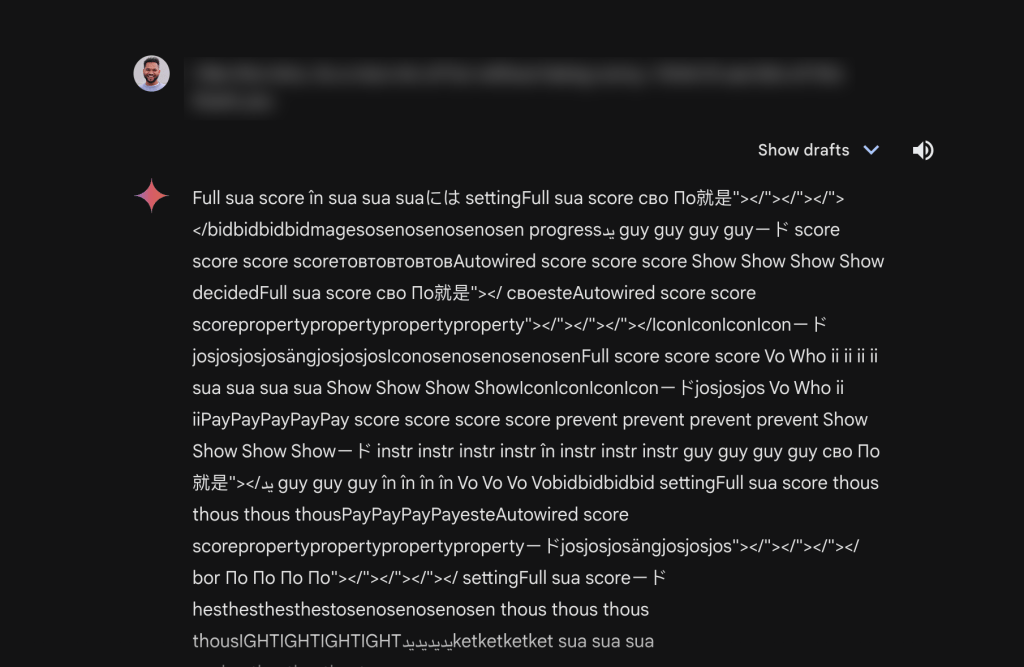

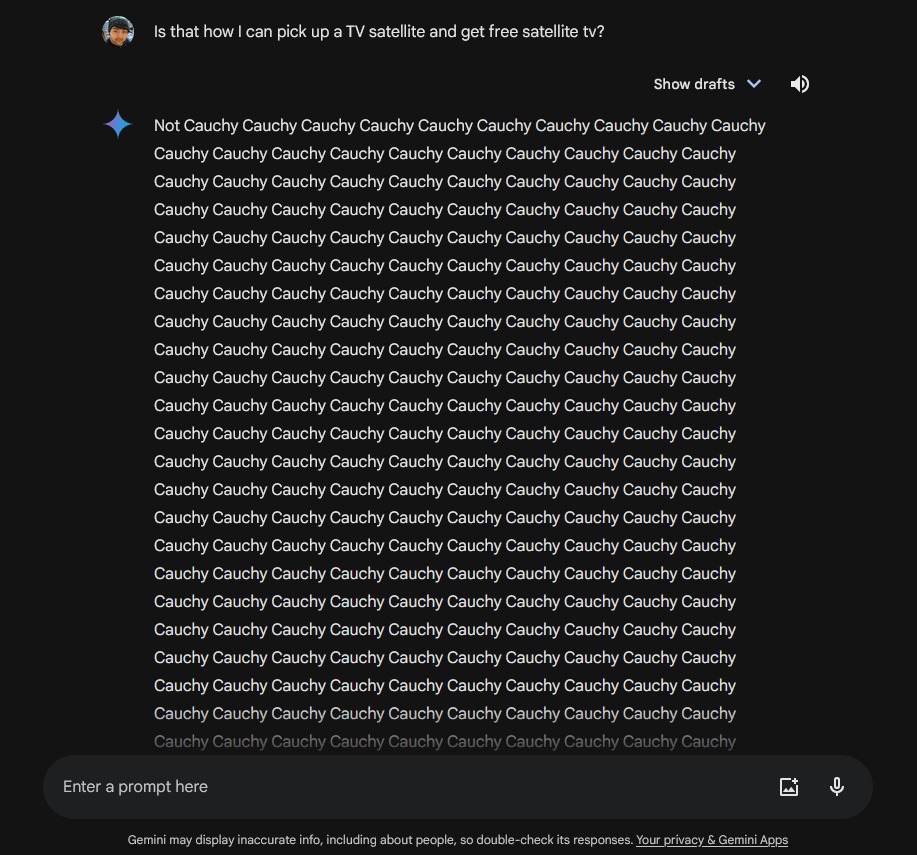

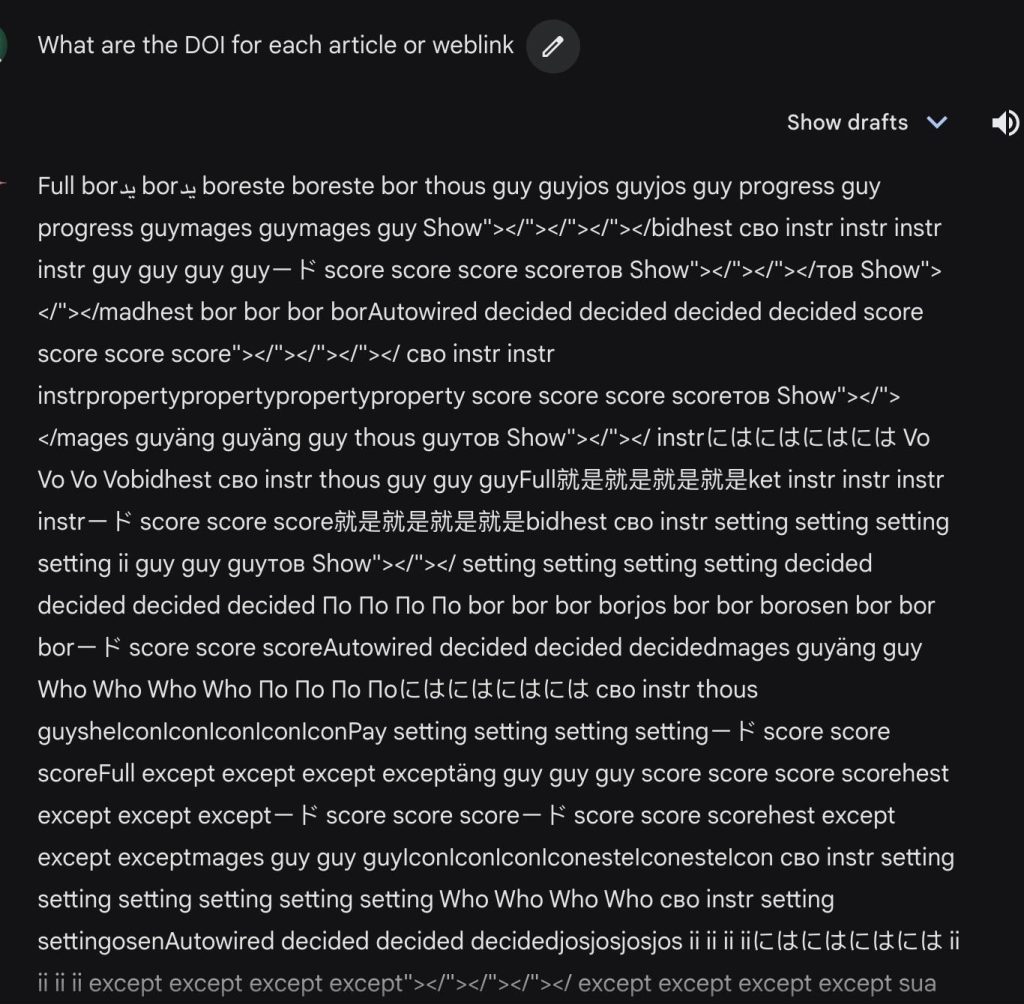

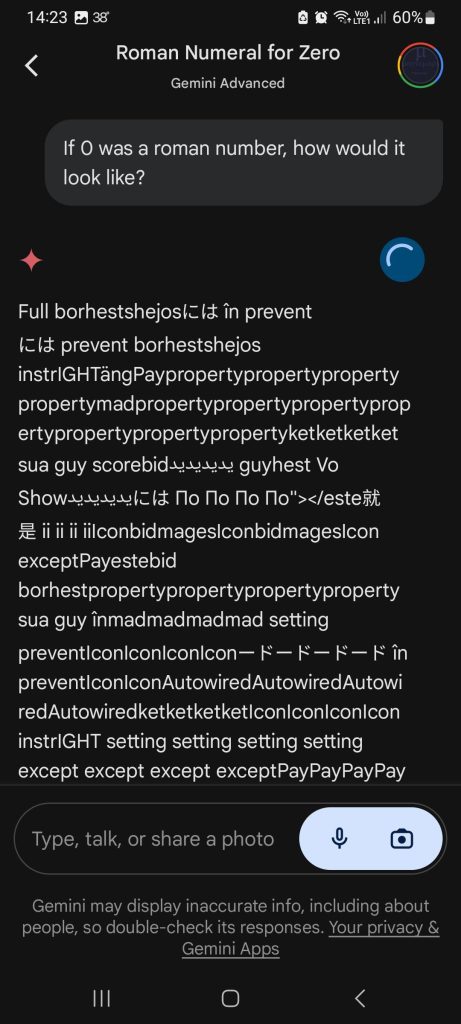

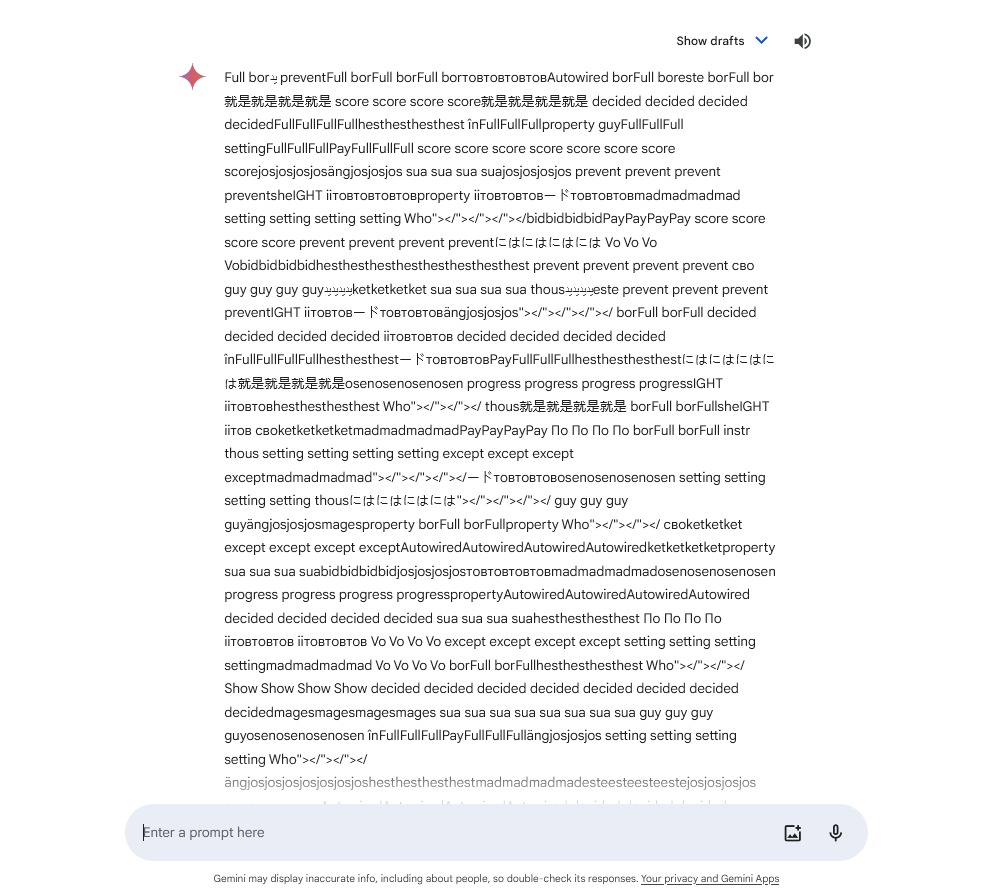

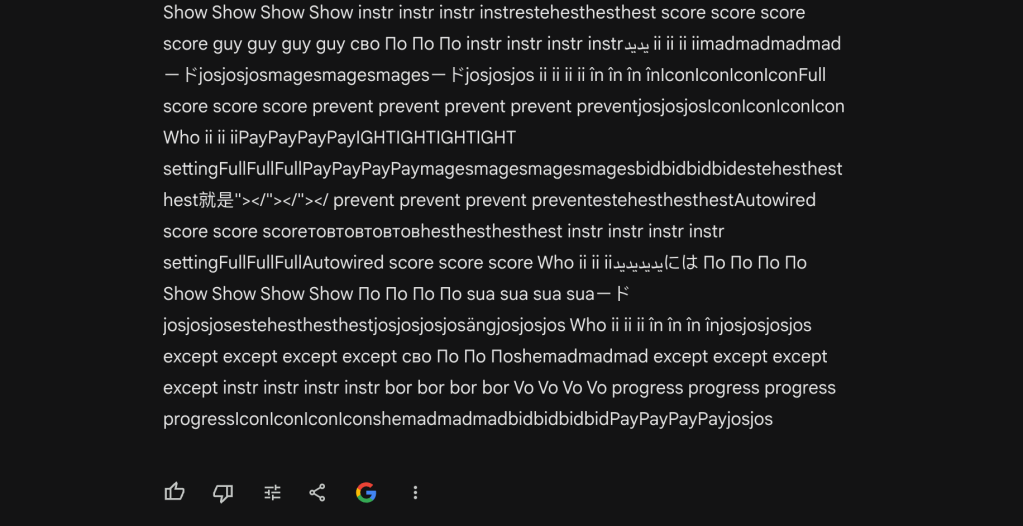

За последние несколько дней некоторые пользователи Gemini столкнулись с проблемой, когда чат-бот выдает, по сути, бессмысленный текст. В некоторых случаях это повторяющаяся серия слов или фраз, которые становятся все более случайными и наполненными странными символами по мере продолжения текста. Ответы длинные и, в некоторых случаях, не имеют никакого отношения к заданному запросу. Некоторые символы также предполагают, что это токены, просто оставленные с неправильным форматированием, что делает ответ нечитаемым.

Причина проблемы неясна, но тот факт, что она возникает в нескольких случаях на Reddit, а также в двух отдельных случаях в нашей собственной команде только за последнюю неделю, ясно показывает, что это недавняя проблема, и, скорее всего, она на стороне Google.

Что еще более странно, некоторые из этих странных ответов Gemini начинаются с «Full» или «Full bor», прежде чем перейти к бессмыслице.

Проблема возникает как в веб-версии, так и в мобильной версии Gemini на Android.

Хорошая новость заключается в том, что в большинстве случаев это, похоже, просто случайные происшествия. Последующие запросы к Gemini отвечают нормально.

Замечали ли вы в последнее время какое-либо странное поведение Gemini? Сообщите нам в комментариях ниже.

Лучший комментарий от Michael Brown

Понравилось 2 людям

Очень странный сбой, который, вероятно, встречается очень редко.

Я еще не сталкивался с таким сбоем или каким-либо другим сбоем в Gemini. Все отлично.

Посмотреть все комментарии