В сентябре Google анонсировал возможность поиска близлежащих мест с использованием дополненной реальности. AR-поиск в Google Maps Live View начнет разворачиваться на следующей неделе, а Google Lens с функцией мультипоиска позволит вам сделать снимок блюда и узнать, где оно доступно поблизости.

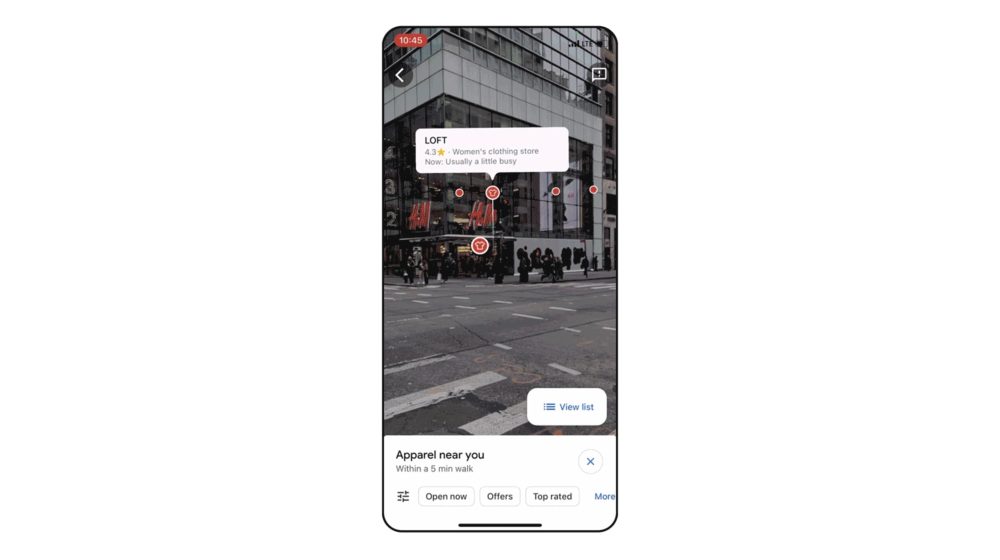

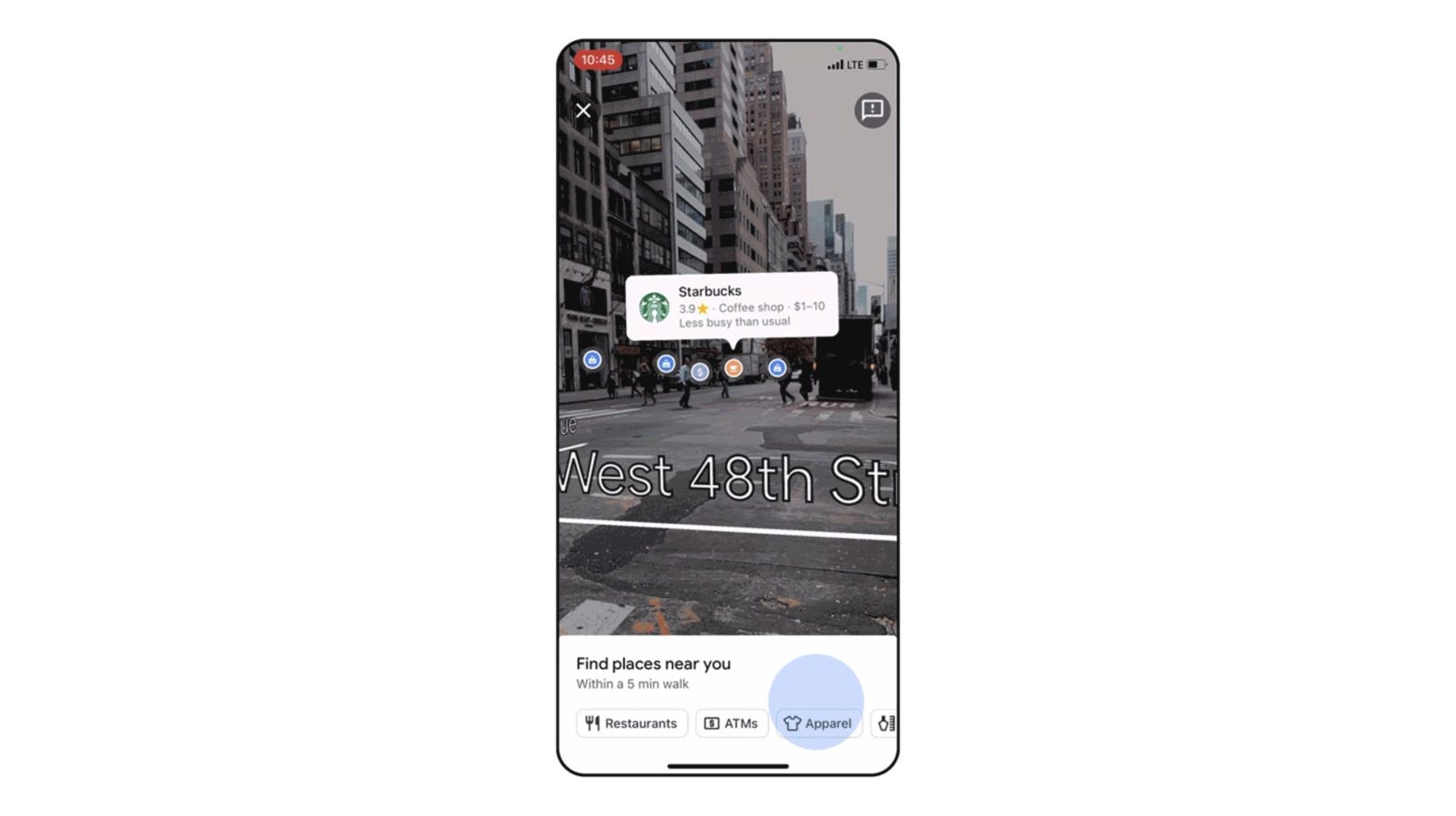

При запуске Live View, который теперь возможен через значок камеры в строке поиска Google Maps, нижняя панель позволит вам «Найти места поблизости», находящиеся «в пределах 5 минут ходьбы». Цветные маркеры с плоской карты используются для выделения точек интереса, а карточка с информацией о центре вашего внимания будет отображаться автоматически.

Вы получите название, значок, рейтинг, категорию/описание, ценовой диапазон, часы работы и информацию о загруженности. Google также выделит места «вне поля зрения», которые «не находятся в вашем непосредственном поле зрения (например, магазин одежды за углом), чтобы получить истинное представление о районе с первого взгляда».

Для поиска в нижней части экрана будет карусель с распространенными категориями, такими как «Рестораны», «Банкоматы», «Одежда» и «Магазины». Также будут доступны фильтры «Открыто сейчас», «Акции» и «Лучшие оценки», а также возможность просмотра списка.

После выбора совпадения будут наложены стрелками, а расстояние указано на карточке. Нажатие запустит построение маршрута. AR-поиск в Google Maps Live View начнет разворачиваться на следующей неделе на Android и iOS в Лос-Анджелесе, Сан-Франциско, Нью-Йорке, Лондоне и Париже.

Тем временем, мультипоиск Google Lens, который позволяет добавлять текстовые запросы к анализируемым изображениям, будет поддерживать возможность сделать снимок или скриншот блюда, а затем добавить «поблизости», чтобы «быстро найти место, где оно продается». Эта функция запускается сегодня для англоязычной аудитории США.

Google также подтвердил, что обновление Lens AR Translate будет развернуто позднее в этом году. Этот метод использует ту же технологию ИИ, что и Pixel Magic Eraser, для удаления оригинального текста и его последующего воссоздания с сохранением стиля, чтобы лучше сохранить контекст, чем текущий подход с цветными блоками, которые закрывают оригинальный текст и затем накладывают новый.

В сфере шопинга новая AR-функция упростит поиск подходящей тональной основы, которая является «одной из самых популярных категорий макияжа». Для повышения точности Google располагает новой фототекой, состоящей из «148 моделей, представляющих разнообразный спектр оттенков кожи, возрастов, полов, форм лица, этнической принадлежности и типов кожи».

Вот как это работает: найдите тональную основу в Google по различным ценам и брендам, например «Armani Luminous Silk Foundation». Вы увидите, как эта тональная основа выглядит на моделях с похожим тоном кожи, включая снимки «до» и «после», чтобы помочь вам решить, какая из них подходит вам лучше всего. Найдя понравившийся продукт, просто выберите розничного продавца для покупки.

Вы также сможете «вращать, увеличивать и рассматривать обувь в своем пространстве» от таких брендов, как Saucony, Vans и Merrell, найдя «Купить синие кроссовки VANS» и используя функцию «Посмотреть в моем пространстве». Эти две функции начинают разворачиваться сегодня.